사랑을 나눌 때 우리가 느끼는 감정은 어떤 모습일까? 네덜란드 작가 카렌 란셀과 헤르만 맷이 뇌파를 형태를 분석해 사랑의 감정을 시각화했다. 심지어 사랑을 나눈 광경을 지켜본 관객의 뇌파까지도 분석했다.

뜨거운 여름, 에어컨 리모컨이 보이지 않을 것만큼 고통스러운 상황이 있을까요? 에어컨에 음성인식 기능을 탑재하지 않은 제조사를 욕해본 적도 있습니다.

우리는 기기를 다룰 때 늘 키보드, 마우스, 리모컨 등 신호를 전달하는 입력 장치에 의지해야만 합니다. 음성 인식과 모션 인식 기술을 넘어 생각만으로 기기를 조작할 수 있는 BCI(Brain-Computer Interface)를 개발 중입니다. 뇌와 컴퓨터를 바로 연결하는 기술이죠. BCI는 뇌에서 만들어진 신호를 받아들이는 신호 측정 과정과 이 신호를 기계가 이해할 수 있는 전기적 신호로 바꾸는 신호 변환 과정, 변환 및 분석한 신호를 장치에 전달하여 명령을 내리는 최종 출력 과정의 세 가지 단계로 이루어집니다. 뇌의 신호를 온전히 기기에 전달하기 위해서는 생각에 집중해야 합니다. 급격한 변화나 돌발 행동은 신호에 노이즈를 발생시킬 수 있기 때문이죠.

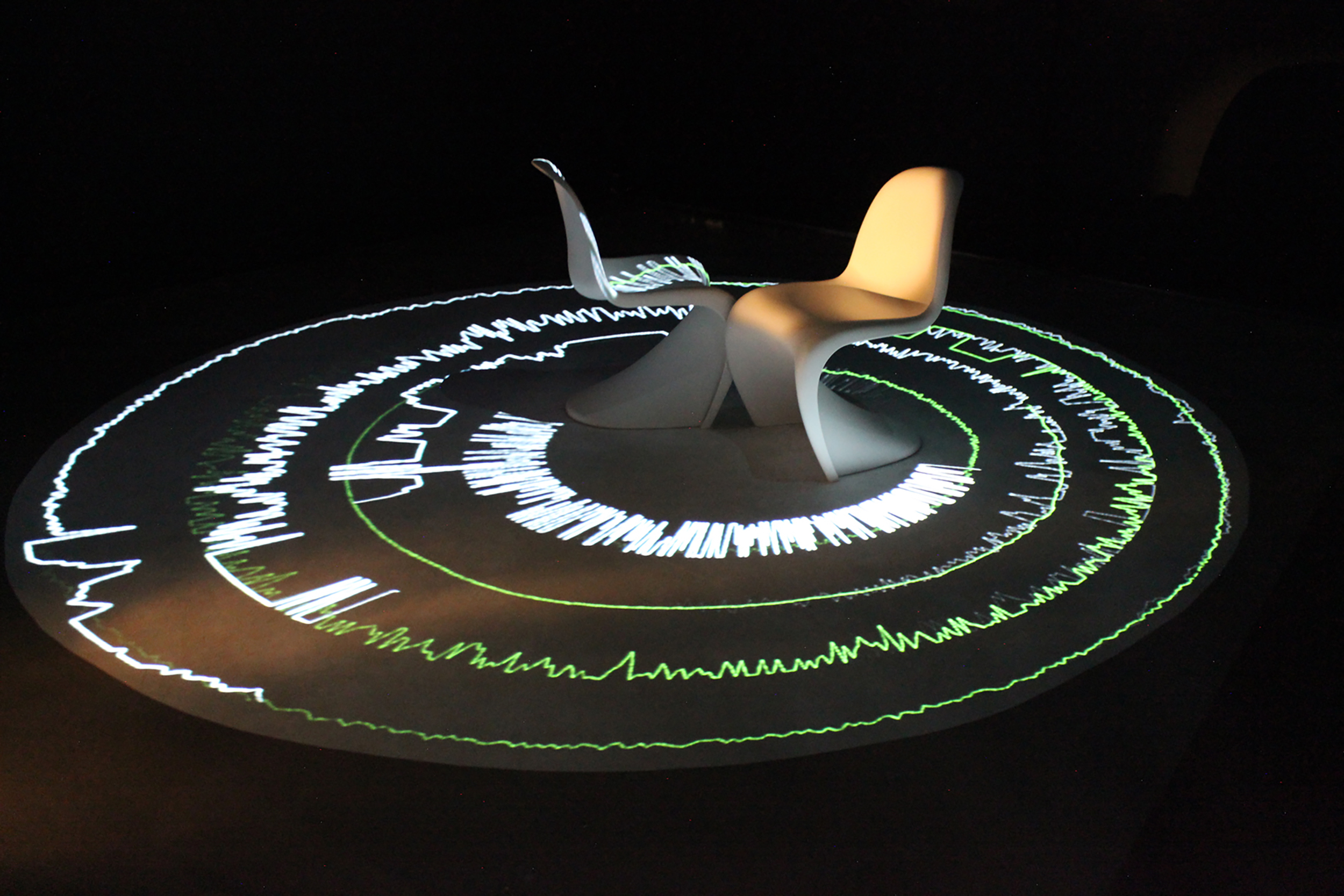

네덜란드 작가 카렌 란셀(Karen Lancel)과 헤르만 맷(Hermen Maat)은 오히려 격한 뇌의 신호를 작품에 이용합니다. 퍼포먼스 작품 <셰어드 센시스: 인티머시 데이터 심포니 Shared Senses: Intimacy Data Sympony>는 인간이 스킨십할 때 발생하는 신호를 측정합니다. 두 사람이 뇌파 측정용 웨어러블 디바이스를 착용하고 무대 중앙 의자에 앉습니다. 그리고 포옹과 키스를 시작하죠. 이때 발생하는 뇌의 신호를 시각화해 무대 바닥에 프로젝터로 보여줍니다. 이 모습을 지켜보는 관객도 작품 참여자입니다. 관객도 신호 측정 장치를 착용하고, 무대 위의 광경을 지켜봅니다. 사랑을 나누는 두 사람의 뇌파와 그 모습을 지켜보는 사람들의 뇌파가 공명하는 모습을 볼 수 있죠. 이 작품의 목적은 간단합니다. 물리적인 스킨십에서 벗어나 컴퓨터 통신으로 사랑을 나눌 수 있는지에 대한 가능성을 확인해보는 거죠.

Q. 감정을 생체 신호로 온전히 해석하는 일 가능할까요?

A. 감정을 온전히 전달할 수 있는 방법이 있을까요? 심지어 우리의 언어로 감정을 100% 전달할 수 있을지도 알 수 없죠. 우리는 인티머시 데이터 심포니를 통해 우리 감정이 어떻게 전이되고 바뀌는지 관찰하고 감정을 신호로 변화해 모두가 공유할 수 있는지에 대한 가능성을 관찰하고 있습니다. 무대에서 키스하는 사람들에게서 EEG(뇌전도) 데이터가 발생합니다. 두피에 전극을 부착하여 그 신호를 측정할 수 있습니다. 저희는 관객의 EEG 데이터까지 수집하기 시작했죠. 스킨십하는 사람과 관객의 뇌전도가 서로 공명하는 순간을 발견했죠. 우리는 이 실험 결과에서 영감을 받아 ‘심포니; 작품명에 넣었죠.

Q. 이 작품의 핵심 기술은 무엇일까요?

A. 뇌 신호를 전자 신호로 바꿔주는 BCI 기술을 사용했습니다. 이 기술을 활용해 글을 쓸 수 있을 정도로 활발히 연구가 진행 중입니다. 지금까지BCI 연구는 사람과 컴퓨터 간의 1대1관계에서의 상호작용을 중심으로 진행되어왔습니다. 우리는 여러 사람의 뇌를 공유하는 멀티-BCI 기술을 도입했습니다. 여러 사람의 EEG를 측정해 이들의 연관성을 분석하는 작업이죠. 이 기술을 활용하면 생각만으로 대화를 할 수 있습니다. 또 생각을 모아 미션을 수행하는 게임을 할 수도 있죠. 인간과 컴퓨터, 인간과 인간을 이어주는 새로운 소통 기술의 근간이 될 수도 있죠.

작품에서 물리적으로는 두 명의 행위자만 스킨십을 합니다. 하지만 디지털 상에서는 행위자와 관객의 EEG가 공명하고 있고, 동시에 여러 사람이 스킨십을 하고 있다고 할 수 있죠.

Q. 디지털 상에서는 여러 사람이 사랑을 나누는 것도 가능할까요?

A. ‘집단 키스’라는 단어가 부정적으로 느껴질 수 있습니다. ‘친근감’ 같은 단어를 수치화 한다는 것도 불편하죠. 감정을 디지털 신호로 전달하는 것부터 문제였죠. 우리는 관객과 함께 사회적 통념을 디지털 상에서 깨는 시도를 했습니다. 이런 시도를 통해 모호했던 것들도 분명해졌습니다. 연대감, 공감대 같이 모호한 것을 눈으로 확인했죠.

Q. 작품을 구현하면서 신경 썼던 부분은 무엇일까요?

A. 감각을 시각화하는 것까지는 성공했습니다. 사람들은 신호로 만들어진 영상을 보면서 어떤 느낌일지 더욱 구체적으로 알 수 있었다고 생각해요. 우리는 이 감정을 극대화할 수 있는 방법을 고민했고, 신호를 소리로 바꾸는 작업을 추가했습니다. EEG 데이터를 악보 알고리즘에 대입했죠. 관객은 각자 해드셋을 착용하고 소리를 듣습니다. 관객의 EEG 데이터를 기반으로 소리가 만들어지고 관객은 모두 다른 소리를 듣게 됩니다.

Q. 앞으로의 계획을 말씀해주세요.

우리의 작품을 받아들이기 힘든 문화권도 있습니다. 하지만 이 작품이 사회적, 기술적으로 긍정적인 영향을 미칠 것이라 믿습니다. 사회 소외계층과의 공감대 형성, 집단의 공동체 의식, 대화와 반성을 위한 도구 등 다양한 분양에 활용이 가능하죠.

작가 소개

카렌 란셀과 헤르만 맷은 예술가와 과학자로 이루어진 듀오로 인공적 감성(Artificial Emotion:AE)과 BCI(Brain computer Interface)를 이용해 지속적으로 프로젝트를 선보이고 있다. 관객 참여형 설치 작품으로 인간의 친밀함 공유를 새로운 방식으로 제안한다. GAAC Global Art & AI Competition 2019 Award China, EMARE /EMAP Award를 수상하고 유럽 미디어 아트 플랫폼 – 유럽 연합 크리에이티브 유럽 프로그램에 참여했다.